Para poder explicar la distribución binomial primero vamos a introducir un concepto denominado Proceso de Bernoulli. Un proceso de Bernoulli es una repetición de n veces de un experimento de Bernoulli, sin embargo, debe aclararse que no toda repetición de n veces es un proceso de Bernoulli.

Para que esas repeticiones sean consideradas un proceso de Bernoulli deben cumplir con ciertas características:

1) Las probabilidades de ocurrencia deben ser independientes una de las otras

2) Las probabilidades de éxito se deben mantener constantes

ambas condiciones están relacionadas entre si: Si las variables aleatorias son independientes entre si en consecuencia las probabilidades de éxito se van a mantener constante, y si las probabilidades de éxito se mantienen constantes va a ser porque las variables son independientes una de las otras.

Ahora bien, ¿Cuándo puede suceder que se mantengan constantes las probabilidades de éxito?

1) Cuando N, el tamaño poblacional, es infinito.

2) Cuando N es finita pero hay reposición de elementos.

3) Cuando N es muy grande, tal que, sin haber reposición de elementos, la cantidad de veces que se repita el experimento (n) sea de una proporción menor al 5% de N. 𝑛/𝑁≤0,05.

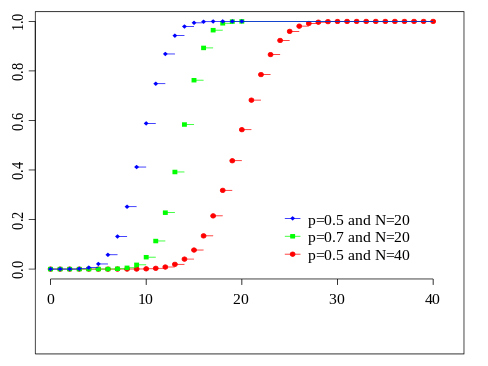

Para representar que una variable aleatoria X sigue una distribución binomial de parámetros n y p, se escribe: X~B(n,p).

Las siguientes situaciones son ejemplos de experimentos que pueden modelizarse por esta distribución:

• Se lanza un dado 5 veces y se cuenta el número Y de tres obtenidos: entonces X ~ B(5, 1/6).

• Se responde (al azar) un examen de 10 preguntas, cada una con 4 opciones de respuestas y solo una de ellas correcta. La variable aleatoria discreta X = número de preguntas correctamente contestadas tiene una distribución X ~ B(10, 1/4).